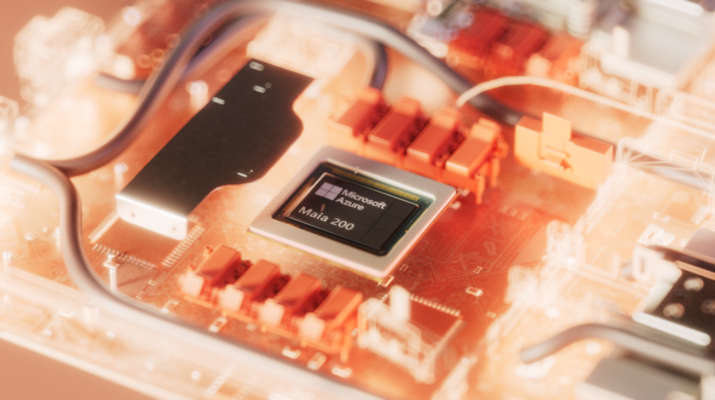

Microsoft presenta Maia 200, un acelerador de inferencia revolucionario diseñado para mejorar de manera importante la economía de la generación de tokens con IA. Maia 200 es una potencia en inferencia de IA: un acelerador construido sobre el proceso de 3nm de TSMC con núcleos tensoriales nativos FP8/FP4, un sistema de memoria rediseñado con 216GB HBM3e a 7 TB/s y 272MB de SRAM integrada, además de motores de movimiento de datos que mantienen los modelos masivos alimentados, rápidos y con una alta utilización. Esto convierte a Maia 200 en el silicio de primera mano más eficiente de cualquier hiperescalador, con tres veces el rendimiento FP4 del Amazon Train de tercera generación y un rendimiento FP8 superior al TPU de séptima generación de Google. Maia 200 es también el sistema de inferencia más eficiente que Microsoft ha desplegado jamás, con un 30% de rendimiento por dólar superior al hardware de última generación de nuestra flota actual.”

Maia 200 forma parte de la infraestructura de IA y servirá para múltiples modelos, incluidos los últimos modelos GPT-5.2 de OpenAI, para aportar una ventaja de rendimiento por dólar a Microsoft Foundry y Microsoft 365 Copilot. El equipo de Microsoft Superintelligence utilizará Maia 200 para la generación de datos sintéticos y el aprendizaje por refuerzo para mejorar los modelos internos de próxima generación. Para casos de uso de pipelines de datos sintéticos, el diseño único de Maia 200 ayuda a acelerar la velocidad a la que se pueden generar y filtrar datos de alta calidad y específicos de dominio, para alimentar la formación posterior con señales más frescas y específicas.